产品

Tensor Engine | 同思引擎技术细节解析:为什么 GPU 虚拟化不能只停留在“切卡”

从一线 AI Infra 的真实矛盾出发,解释 GPU 虚拟化的四条路线,以及同思引擎为什么选择“从设备走向算力”的架构方向。

付费文章

案例研究

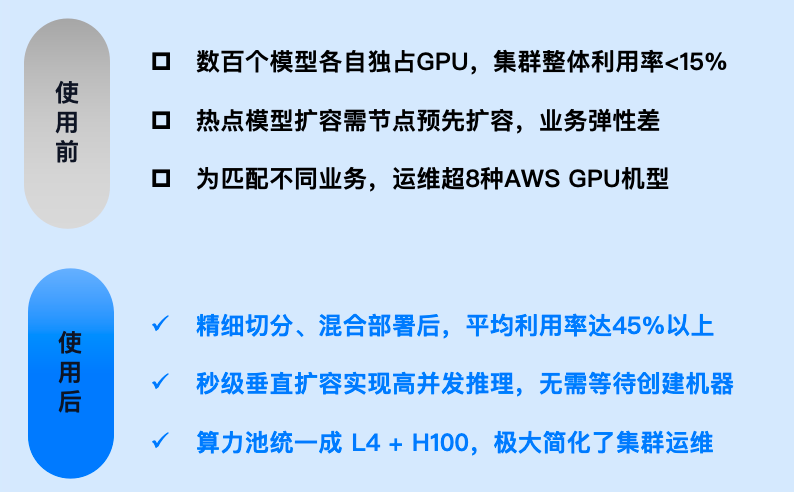

某全球领先企业协作平台:全球多区域 GPU 推理成本降低 58%–65%

20+ 业务线、100+ AI 模型、全球十余个 Region——一家全球领先的企业协作平台如何用 TensorFusion 实现 GPU 算力精细化管理与大规模降本

产品

AI 基础设施伙伴如何构建联邦算力网络并管理 SLA

以客户真实处境出发:跨集群调度、数据本地化与 SLA 三者如何同时成立。

产品

GPU 厂商伙伴如何通过多租户隔离提升算力变现

站在客户视角:如何把"淡季闲置算力"变成收入,同时又能让企业客户放心。

产品

GPU FinOps 实战:实例选型、Karpenter 与成本护栏

从客户真实经历出发,讲清楚如何通过选型、弹性与成本护栏,让 GPU 支出变得可预测。

产品

MLOps 团队如何缩短训练与推理流水线周期

从客户视角讲清楚:为什么 GPU 排队会拖慢迭代,以及怎样通过资源池化把训练与推理各归其位。