某全球领先企业协作平台:全球多区域 GPU 推理成本降低 58%–65%

20+ 业务线、100+ AI 模型、全球十余个 Region——一家全球领先的企业协作平台如何用 TensorFusion 实现 GPU 算力精细化管理与大规模降本

该客户将 AI 推理工作负载迁移至 TensorFusion,在保障业务高峰期 40% GPU 冗余的前提下,实现 58%–65% 的推理成本优化,同时显著提升了弹性扩缩容能力。

关于客户

该客户是一家全球领先的企业协作平台,已从视频会议厂商发展成综合性 B2B 协作平台。业务峰值达每秒十万级的会议与通话,并承载邮件、即时通讯、在线文档、日历等大量协作业务。每个业务线背后都依赖不同的 AI 模型来驱动智能化体验。

| 维度 | 数据 |

|---|---|

| 基础设施 | 多云(AWS / Azure / OCI)+ 自建数据中心 |

| 业务线 | 20+ |

| AI 模型数量 | 100+(含自研、开源、微调模型) |

| 模型类型 | 文本、语音、图像;传统深度学习 + Transformer 架构 |

| 部署区域 | 全球十余个 Region |

核心问题:GPU 成本随模型数量线性增长

随着 AI 功能覆盖到越来越多的业务线,该客户面对的不是单一模型的算力问题,而是一个系统性的成本难题——问题出在 GPU 的分配方式本身。

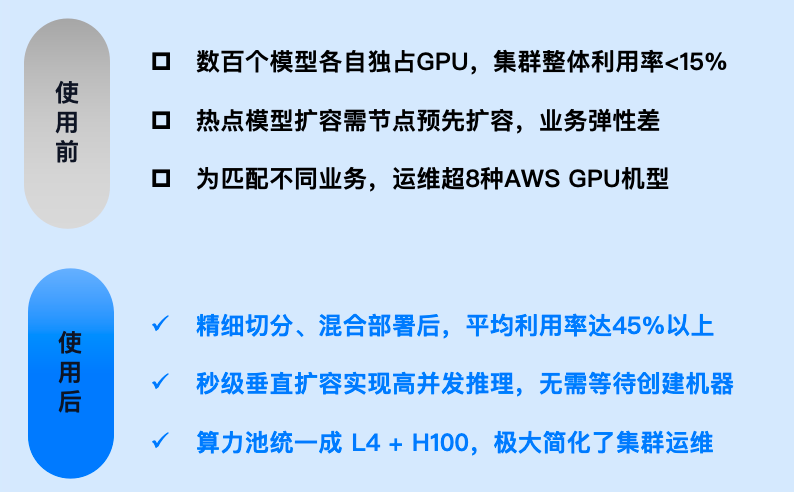

整卡分配,碎片严重

传统模式下,不管实际需求多少,每个工作负载都会分到一整张显卡。一个只需要 2GB 显存的轻量语音模型,和一个需要 40GB 的大型 Transformer 模型,占用的都是同一规格的整卡。对平台工程团队来说,大量算力被闲置,但预算却在持续增长。

新模型上线 = 新一轮 GPU 采购

业务团队每上线一个新模型就需要申请独立的 GPU 资源。模型从几十个增长到 100+,基础设施成本几乎线性增长。没有共享算力层来以边际成本吸收新负载——每一次 AI 功能扩展都意味着新的采购周期。

多 Region 成倍放大

同一个模型需要在全球多个 Region 部署,整卡分配的碎片问题在每个 Region 重复一遍。单个 Region 或许还能接受的低效,乘以十几个 Region 就变成了严重的成本驱动因素。

迁移策略:深入业务、兼容先行、渐进灰度

TensorFusion 没有采用"一刀切替换"的方式,而是针对该客户的复杂多云环境设计了三阶段推进方案。

第一步:逐个业务深入分析

在动任何基础设施之前,先做精细化的摸底:逐一分析每个模型的实际算力需求和显存消耗,按业务场景分类(实时推理 / 批量处理 / 低频调用),按 Region 评估流量模式和峰值特征。

不是所有业务都适合同一种迁移节奏,精确的业务画像决定了迁移顺序和每个阶段的预期收益。

第二步:兼容模式并行运行

迁移不能影响线上业务。TensorFusion 实现了与 NVIDIA Operator & Device Plugin 的完全兼容——已分配的 GPU 卡不受任何影响,迁移后的应用和未迁移的应用在同一个节点池中安全共存,无需硬切换。

第三步:按 Region + 流量百分比灰度切换

不是一次性切流,而是按 Region 逐个推进,每个 Region 内按流量百分比渐进迁移。任何异常都可以快速回滚——风险始终可控。

技术挑战:在飞行中换引擎

大规模渐进迁移中,最复杂的不是新系统的部署,而是新旧系统共存时的一系列边界问题。

调度冲突:双向隔离

渐进迁移意味着同一个节点池上同时运行 TensorFusion 管理的 Pod 和传统 Device Plugin 管理的 Pod。必须解决双向冲突:

- 正向:上报现有 Device Plugin 的分配数据,在调度器的 filter 阶段处理,防止 TensorFusion 调度到已被占用的卡。

- 反向:同样要避免未迁移的 GPU Pod 被调度到已由 TensorFusion 接管的 GPU 上。

任何一个方向出问题,都会影响线上业务——这就是"飞行中换引擎"的真实含义。

GPU 驱动热更新兼容

TensorFusion 实现了对 GPU Operator Hot Upgrade Driver 事件的感知,避免驱动热更新过程中运行中的工作负载无法识别 CUDA 设备——这在滚动基础设施更新时是实际存在的风险。

批量迁移利器:智能准入控制

自研的 AdmissionWebhook 智能 allow/block list 策略,协助业务团队按命名空间、标签等维度批量迁移 GPU 业务,无需逐个 Deployment 手动改配置。这将一个可能持续数月的逐应用迁移,变成了系统化的、按团队推进的操作。

联合优化 LLM 推理链路

TensorFusion 与客户工程团队联合在 LLM 推理链路上做端到端优化:

- Prefill-Decode 分离(PD 分离),提升大模型推理吞吐

- vLLM 层面的配置调优

- 多种 KV Cache 复用策略的测试与落地

- 不同 GPU Instance Type 的实际业务压测与性价比对比

- 已使用 timeslicing 的租户平滑转换至 TensorFusion

深度系统集成

Metrics 格式按客户内部监控体系定制,添加业务维度的 metric label,无缝接入现有的可观测性平台。

实施结果

某个 Region 的真实数据:9 月开始迁移应用,在保障业务高峰期 GPU 使用率还有 40% 冗余的情况下,成本下降了 58%。其他 Region 的优化幅度达到最高 65%。

| 指标 | 迁移前 | 迁移后 |

|---|---|---|

| GPU 推理成本 | 基线 | 降低 58%–65% |

| GPU 分配方式 | 整卡分配,碎片严重 | 精细化切分,按需分配 |

| 新模型上线成本 | 线性增长 | 共享算力池,边际成本趋近于零 |

| 弹性扩缩容 | 手动,响应慢 | 三种模式,Karpenter 集成,自动化 |

| 业务高峰期冗余 | 不可控 | 40% 冗余保障 |

| 迁移风险 | — | Region + 流量灰度,随时可回滚 |

弹性扩缩容:三种模式,全自动

TensorFusion 支持三种节点扩缩容模式,与 Karpenter 深度集成,让弹性伸缩真正转化为成本节约:

| 模式 | 适用场景 |

|---|---|

| 直接 EC2 API 扩容 | 通过 AWS IAM Role (IRSA) 直接调用 EC2 API,快速扩容节点 |

| 托管 Karpenter CR | 创建 NodeClaim 对象指向 GPU Pool 托管节点,TensorFusion 完全管理节点生命周期 |

| 复用现有 Karpenter CR | 选择合适的 NodeClaim 复制扩容,交由 Karpenter 做动态 Bin-packing 和空节点缩容,对现有基础设施侵入最小 |

常见疑问

"GPU 虚拟化会增加推理延迟吗?" TensorFusion 的虚拟化在驱动层实现,开销接近零。在客户的生产环境中,推理延迟保持在迁移前的基线范围内。对于延迟敏感的实时模型(语音、视频处理),迁移前已做过充分验证。

"迁移过程对业务影响大吗?" 三阶段方案的核心就是降低影响。兼容模式保证现有工作负载不受触动,流量按 Region、按百分比渐进切换,随时可回滚。客户的生产服务在整个迁移过程中没有发生停机。

"需要替换现有的 NVIDIA 技术栈吗?" 不需要。TensorFusion 的兼容模式可以与现有 NVIDIA Operator 和 Device Plugin 并行工作。迁移后的工作负载和未迁移的工作负载在同一节点上共存,不需要移除或替换现有的 GPU 管理工具。

为什么该客户选择了 TensorFusion

回到最初的问题:该客户面对的不是某一个模型的算力瓶颈,而是一个结构性挑战——100+ AI 模型、20+ 业务线、10+ Region,每个都按整卡分配 GPU,成本随模型数量线性增长。手动调优解决不了根本的分配模式问题。

TensorFusion 在正确的层面解决了这个问题:精细化 GPU 切分消除碎片,共享算力池以接近零的边际成本吸收新模型,渐进式的 Region 级迁移路径保障了生产环境始终安全。

如果你的组织也在多团队、多区域运行多样化的 AI 工作负载,且 GPU 成本的增长跟着模型数量走而不是跟着实际计算需求走——这套方案值得评估。

登录以继续阅读

这是一篇付费内容,请登录您的账户以访问完整内容。

更多文章

GPU FinOps 实战:实例选型、Karpenter 与成本护栏

从客户真实经历出发,讲清楚如何通过选型、弹性与成本护栏,让 GPU 支出变得可预测。

Tensor Engine | 同思引擎技术细节解析:为什么 GPU 虚拟化不能只停留在“切卡”

从一线 AI Infra 的真实矛盾出发,解释 GPU 虚拟化的四条路线,以及同思引擎为什么选择“从设备走向算力”的架构方向。

金融行业如何用池化 GPU 降低风险分析延迟

某金融机构通过 TensorFusion 池化 GPU 资源,加速反欺诈与风险评分,同时降低约 38% GPU 成本。

邮件列表

加入我们的社区

订阅邮件列表,及时获取最新消息和更新